Introduzione all'eliminazione a ritroso

Mentre l'uomo e la macchina si muovono verso l'evoluzione digitale, diverse macchine tecniche stanno valutando di non solo essere addestrate, ma abilmente addestrate per uscire con un migliore riconoscimento degli oggetti del mondo reale. Una tale tecnica introdotta in precedenza chiamata "Eliminazione all'indietro" che intendeva favorire le caratteristiche indispensabili sradicando al contempo le caratteristiche nugatorie per concedere una migliore ottimizzazione in una macchina. L'intera competenza del riconoscimento di oggetti da parte di Machine è proporzionale alle caratteristiche che considera.

Le funzioni che non hanno alcun riferimento sull'uscita prevista devono essere scaricate dalla macchina e si concludono mediante eliminazione all'indietro. Buona precisione e complessità temporale del riconoscimento di qualsiasi oggetto parola reale da parte di Machine dipendono dal suo apprendimento. L'eliminazione all'indietro svolge quindi un ruolo rigido nella selezione delle funzionalità. Calcola il tasso di dipendenza delle caratteristiche dalla variabile dipendente trova il significato della sua appartenenza al modello. Per accreditarlo, controlla la tariffa calcolata con un livello di significatività standard (diciamo 0, 06) e prende una decisione per la selezione della funzione.

Perché chiediamo l'eliminazione all'indietro ?

I tratti non essenziali e ridondanti spingono la complessità della logica della macchina. Divora inutilmente tempo e risorse del modello. Quindi la suddetta tecnica gioca un ruolo competente nel forgiare il modello in modo semplice. L'algoritmo coltiva la migliore versione del modello ottimizzando le sue prestazioni e troncando le sue risorse nominali sacrificabili.

Riduce le caratteristiche meno degne di nota del modello che causano rumore nel decidere la linea di regressione. Tratti di oggetto irrilevanti possono generare errori di classificazione e previsione. Le caratteristiche irrilevanti di un'entità possono costituire uno squilibrio nel modello rispetto ad altre caratteristiche significative di altri oggetti. L'eliminazione all'indietro favorisce l'adattamento del modello al caso migliore. Pertanto, si consiglia l'eliminazione all'indietro in un modello.

Come applicare l'eliminazione a ritroso?

L'eliminazione all'indietro inizia con tutte le variabili di funzione, testandola con la variabile dipendente in base a un adattamento selezionato del criterio del modello. Inizia a sradicare quelle variabili che deteriorano la linea di adattamento della regressione. Ripetendo questa cancellazione fino a quando il modello non raggiunge una buona misura. Di seguito sono riportati i passaggi per esercitarsi nell'eliminazione all'indietro:

Passaggio 1: scegliere il livello di significatività appropriato per risiedere nel modello della macchina. (Prendi S = 0, 06)

Passaggio 2: inserire nel modello tutte le variabili indipendenti disponibili rispetto alla variabile dipendente e al computer la pendenza e intercettare per tracciare una linea di regressione o linea di adattamento.

Passaggio 3: attraversare con tutte le variabili indipendenti che possiedono il valore più alto (Take I) uno per uno e procedere con il seguente brindisi: -

a) Se I> S, eseguire il 4 ° passaggio.

b) Altrimenti interrompere e il modello è perfetto.

Passaggio 4: rimuovere la variabile scelta e incrementare l'attraversamento.

Passaggio 5: forgiare nuovamente il modello, calcolare la pendenza e intercettare nuovamente la linea di raccordo con le variabili residue.

Le fasi sopra menzionate sono riassunte nel rifiuto di quelle caratteristiche il cui tasso di significatività è superiore al valore di significatività selezionato (0, 06) per eludere la classificazione eccessiva e la sovrautilizzazione delle risorse che sono state osservate come altamente complesse.

Meriti e demeriti dell'eliminazione arretrata

Ecco alcuni meriti e demeriti dell'eliminazione arretrata indicati di seguito in dettaglio:

1. Meriti

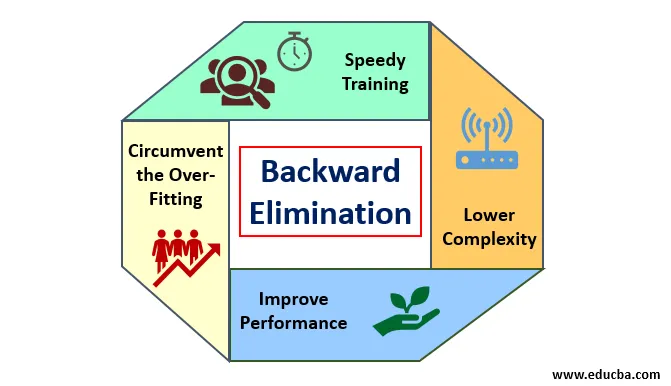

I meriti dell'eliminazione all'indietro sono i seguenti:

- Addestramento rapido: la macchina viene addestrata con una serie di funzioni disponibili del modello, che viene eseguita in brevissimo tempo se le funzioni non essenziali vengono rimosse dal modello. L'addestramento rapido del set di dati viene visualizzato solo quando il modello ha a che fare con funzionalità significative ed esclude tutte le variabili di rumore. Disegna una semplice complessità per l'allenamento. Ma il modello non dovrebbe subire un sottoadattamento che si verifica a causa della mancanza di funzionalità o di campioni inadeguati. La funzione di esempio dovrebbe essere abbondante in un modello per la migliore classificazione. Il tempo necessario per la formazione del modello dovrebbe essere inferiore, pur mantenendo l'accuratezza della classificazione e lasciato senza alcuna variabile di sottostima.

- Complessità inferiore: la complessità del modello sembra essere elevata se il modello contempla l'estensione delle funzionalità tra cui rumore e funzionalità non correlate. Il modello richiede molto spazio e tempo per elaborare una tale gamma di funzionalità. Ciò può aumentare il tasso di accuratezza del riconoscimento del pattern, ma anche il tasso può contenere rumore. Per sbarazzarsi di una complessità così elevata del modello, l'algoritmo di eliminazione all'indietro svolge un ruolo necessario ridimensionando le funzionalità indesiderate dal modello. Semplifica la logica di elaborazione del modello. Solo alcune funzionalità essenziali sono ampie per disegnare una buona misura che contenta ragionevole accuratezza.

- Migliora le prestazioni: le prestazioni del modello dipendono da molti aspetti. Il modello subisce l'ottimizzazione utilizzando l'eliminazione all'indietro. L'ottimizzazione del modello è l'ottimizzazione del set di dati utilizzato per l'addestramento del modello. Le prestazioni del modello sono direttamente proporzionali al suo tasso di ottimizzazione che si basa sulla frequenza di dati significativi. Il processo di eliminazione all'indietro non ha lo scopo di avviare l'alterazione da alcun predittore a bassa frequenza. Ma inizia solo l'alterazione dei dati ad alta frequenza perché la complessità del modello dipende principalmente da quella parte.

- Aggirare l' eccessivo adattamento: la situazione di eccesso di adattamento si verifica quando il modello ha ottenuto troppi set di dati e viene condotta la classificazione o la previsione in cui alcuni predicatori ottengono il rumore di altre classi. In questo montaggio, il modello avrebbe dovuto fornire una precisione inaspettatamente elevata. In caso di eccesso di adattamento, il modello potrebbe non riuscire a classificare la variabile a causa della confusione creata nella logica a causa di troppe condizioni. La tecnica di eliminazione all'indietro riduce la funzione estranea per aggirare la situazione di eccesso di adattamento.

2. Demeriti

I demeriti dell'eliminazione all'indietro sono i seguenti:

- Nel metodo di eliminazione all'indietro, non si può scoprire quale predatore sia responsabile del rifiuto di un altro predicatore a causa della sua insignificanza. Ad esempio, se il predicatore X ha un significato abbastanza buono da risiedere in un modello dopo aver aggiunto il predicatore Y. Ma il significato di X diventa obsoleto quando un altro predicatore Z entra nel modello. Quindi l'algoritmo di eliminazione all'indietro non è evidente su alcuna dipendenza tra due predittori che si verificano nella "tecnica di selezione diretta".

- Dopo aver scartato qualsiasi funzione da un modello mediante un algoritmo di eliminazione all'indietro, tale funzione non può essere nuovamente selezionata. In breve, l'eliminazione all'indietro non ha un approccio flessibile per aggiungere o rimuovere funzionalità / predittori.

- Le norme per selezionare il valore di significatività (0, 06) nel modello non sono flessibili. L'eliminazione a ritroso non ha una procedura flessibile per non solo scegliere, ma anche cambiare il valore insignificante come richiesto al fine di ottenere l'adattamento migliore in un set di dati adeguato.

Conclusione

La tecnica di eliminazione all'indietro realizzata per migliorare le prestazioni del modello e ottimizzarne la complessità. È vividamente utilizzato in regressioni multiple in cui il modello si occupa dell'esteso set di dati. È un approccio facile e semplice rispetto alla selezione diretta e alla convalida incrociata in cui si è verificato un sovraccarico di ottimizzazione. La tecnica di eliminazione all'indietro avvia l'eliminazione di caratteristiche di valore di significatività superiore. Il suo obiettivo di base è rendere il modello meno complesso e vietare situazioni di adattamento eccessivo.

Articoli consigliati

Questa è una guida all'eliminazione all'indietro. Qui discutiamo come applicare l'eliminazione a ritroso insieme ai meriti e ai demeriti. Puoi anche consultare i seguenti articoli per saperne di più-

- Apprendimento automatico iperparametro

- Clustering in Machine Learning

- macchina virtuale Java

- Apprendimento automatico senza supervisione