Introduzione agli algoritmi di classificazione

Questo articolo sugli algoritmi di classificazione offre una panoramica dei diversi metodi di classificazione comunemente utilizzati nelle tecniche di data mining con principi diversi. La classificazione è una tecnica che classifica i dati in un numero distinto di classi e che a loro volta vengono assegnate etichette a ciascuna classe. L'obiettivo principale della classificazione è quello di identificare la classe per il lancio di nuovi dati mediante l'analisi del set di formazione vedendo i limiti adeguati. In generale, prevedere la classe target e il processo sopra descritto è chiamato classificazione.

Ad esempio, la direzione dell'ospedale registra il nome, l'indirizzo, l'età, la storia precedente della salute del paziente per la diagnosi, questo aiuta a classificare i pazienti. Possono essere caratterizzati in due fasi: una fase di apprendimento e una fase di valutazione. La fase di apprendimento modella la base di approccio con dati di formazione mentre la fase di valutazione prevede l'output per i dati dati. Potremmo trovare le loro applicazioni nella posta elettronica spam, previsione del prestito bancario, riconoscimento vocale, analisi del sentiment. La tecnica include la funzione matematica f con input X e output Y.

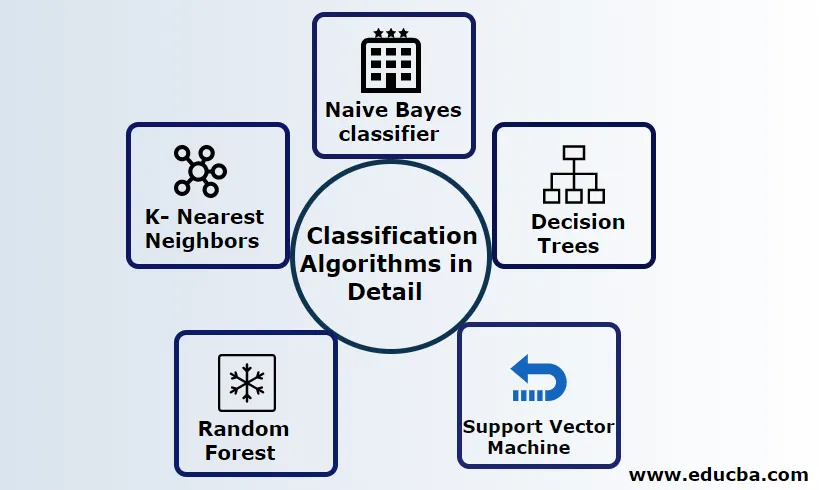

Spiegare gli algoritmi di classificazione in dettaglio

La classificazione può essere eseguita su dati strutturati e non strutturati. La classificazione può essere classificata in

- Classificatore Naive Bayes

- Alberi decisionali

- Support Vector Machine

- Foresta casuale

- K- I vicini più vicini

1) Classificatore Naive Bayes

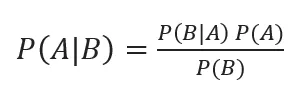

È un algoritmo basato sul teorema di Bayes, una delle classificazioni statistiche e richiede poche quantità di dati di addestramento per stimare i parametri noti anche come classificatori probabilistici. È considerato il classificatore più veloce, altamente scalabile e gestisce sia dati discreti che continui. Questo algoritmo utilizzato per effettuare una previsione in tempo reale. Esistono diversi tipi di classificatore ingenuo, Naïve Bayes multinomiale, Bernoulli Naïve Bayes, ingenuo gaussiano.

La classificazione bayesiana con probabilità posteriori è data da

Dove A, B sono eventi, P (A | B) - Probabilità posteriori.

Se due valori sono indipendenti l'uno dall'altro,

P (A, B) = P (A) P (B)

Naïve Bayes può essere compilato usando la libreria python. I predittori di Naïve sono indipendenti, sebbene vengano utilizzati nei sistemi di raccomandazione. Sono utilizzati in molte applicazioni in tempo reale e ben consapevolmente utilizzati nella classificazione dei documenti.

vantaggi:

I vantaggi sono che richiedono una potenza computazionale molto inferiore, ipotizzata in problemi di previsione a più classi, che lavora con precisione su set di dati di grandi dimensioni.

Svantaggio:

Lo svantaggio principale di questo classificatore è che assegneranno probabilità zero. E hanno funzionalità che sono indipendenti l'una dall'altra.

2) Albero decisionale

È un modello di approccio top-down con la struttura del diagramma di flusso che gestisce dati ad alta dimensione. I risultati sono previsti in base alla variabile di input fornita. Albero decisionale composto dai seguenti elementi: una radice, molti nodi, rami, foglie. Il nodo radice fa la partizione in base al valore dell'attributo della classe, il nodo interno prende un attributo per un'ulteriore classificazione, i rami prendono una regola decisionale per dividere i nodi in nodi foglia, infine, i nodi foglia ci danno il risultato finale. La complessità temporale dell'albero decisionale dipende dal numero di record, dagli attributi dei dati di addestramento. Se l'albero decisionale è troppo lungo, è difficile ottenere i risultati desiderati.

Vantaggio: vengono applicati per analisi predittive per risolvere i problemi e utilizzati nelle attività quotidiane per scegliere l'obiettivo in base all'analisi delle decisioni. Crea automaticamente un modello basato sui dati di origine. Migliore gestione dei valori mancanti.

Svantaggio: la dimensione dell'albero è incontrollabile fino a quando non presenta alcuni criteri di arresto. A causa della loro struttura gerarchica l'albero è instabile.

3) Supporto macchina vettoriale

Questo algoritmo svolge un ruolo vitale nei problemi di classificazione e più comunemente un algoritmo supervisionato di apprendimento automatico. È uno strumento importante utilizzato dal ricercatore e dal data scientist. Questo SVM è molto semplice e il suo processo consiste nel trovare un iperpiano in uno spazio N-dimensionale punti dati. Gli iperpiani sono limiti di decisione che classificano i punti dati. Tutto questo vettore si avvicina all'iperpiano, massimizza il margine del classificatore. Se il margine è massimo, il più basso è l'errore di generalizzazione. La loro implementazione può essere fatta con il kernel usando python con alcuni set di dati di training. L'obiettivo principale dell'SVM è di formare un oggetto in una particolare classificazione. SVM non si limita a diventare un classificatore lineare. SVM è preferito più di qualsiasi modello di classificazione a causa della loro funzione del kernel che migliora l'efficienza computazionale.

Vantaggio: sono altamente preferibili per la sua minore potenza computazionale e precisione effettiva. Efficace in spazi ad alta dimensione, buona efficienza della memoria.

Svantaggio: limiti di velocità, kernel e dimensioni

4) Foresta casuale

È un potente algoritmo di apprendimento automatico basato sull'approccio di apprendimento di Ensemble. Il blocco di base della foresta casuale è l'albero decisionale utilizzato per costruire modelli predittivi. La dimostrazione del lavoro include la creazione di una foresta di alberi decisionali casuali e il processo di potatura viene eseguito impostando una divisione delle interruzioni per ottenere un risultato migliore. La foresta casuale viene implementata usando una tecnica chiamata insaccamento per il processo decisionale. Questo insaccamento impedisce un eccesso di adattamento dei dati riducendo la distorsione allo stesso modo in cui questo casuale può ottenere una migliore precisione. Una previsione finale è presa da una media di molti alberi decisionali, ovvero previsioni frequenti. La foresta casuale include molti casi d'uso come previsioni di borsa, rilevamento di frodi, previsioni di notizie.

vantaggi:

- Non richiede grandi elaborazioni per elaborare i set di dati e costruire un modello molto semplice. Fornisce una maggiore precisione per risolvere i problemi predittivi.

- Funziona bene nella gestione dei valori mancanti e rileva automaticamente un valore anomalo.

Svantaggio:

- Richiede costi di calcolo elevati e memoria elevata.

- Richiede molto più periodo di tempo.

5) K- I vicini più vicini

Qui discuteremo l'algoritmo K-NN con l'apprendimento supervisionato per CART. Usano un intero piccolo positivo K; un oggetto viene assegnato alla classe in base ai vicini o diremo che si assegna un gruppo osservando in quale gruppo si trova il vicino. Questo viene scelto dalla misura della distanza distanza euclidea e da una forza bruta. Il valore di K può essere trovato usando il processo di Sintonizzazione. KNN non preferisce apprendere alcun modello per addestrare un nuovo set di dati e utilizzare la normalizzazione per ridimensionare i dati.

Vantaggio: produce risultati efficaci se i dati di allenamento sono enormi.

Svantaggio: il problema maggiore è che se la variabile è piccola funziona bene. In secondo luogo, scegliere il fattore K durante la classificazione.

Conclusione

In conclusione, abbiamo esaminato le capacità di diversi algoritmi di classificazione che agiscono ancora come uno strumento potente nell'ingegnerizzazione delle caratteristiche, la classificazione delle immagini che gioca una grande risorsa per l'apprendimento automatico. Gli algoritmi di classificazione sono potenti algoritmi che risolvono problemi difficili.

Articoli consigliati

Questa è una guida agli algoritmi di classificazione nell'apprendimento automatico. Qui discutiamo che la classificazione può essere eseguita su dati strutturati e non strutturati. Puoi anche consultare i nostri altri articoli suggeriti:

- Algoritmi di routing

- Algoritmo di clustering

- Processo di data mining

- Algoritmi di apprendimento automatico

- Tecniche più utilizzate per l'apprendimento degli ensemble

- Algoritmo C ++ | Esempi di algoritmo C ++