Introduzione all'albero decisionale nell'apprendimento automatico

L'albero decisionale nell'apprendimento automatico ha un ampio campo nel mondo moderno. Ci sono molti algoritmi in ML che vengono utilizzati nella nostra vita quotidiana. Uno degli algoritmi importanti è l'albero decisionale che viene utilizzato per la classificazione e anche una soluzione per i problemi di regressione. Trattandosi di un modello predittivo, l'analisi dell'albero decisionale viene eseguita mediante un approccio algoritmico in cui un set di dati è suddiviso in sottoinsiemi secondo le condizioni. Il nome stesso dice che è un modello ad albero sotto forma di istruzioni if-then-else. Più è profondo l'albero e più sono i nodi, migliore è il modello.

Tipi di albero decisionale nell'apprendimento automatico

Albero decisionale è un grafico ad albero in cui l'ordinamento inizia dal nodo radice al nodo foglia fino al raggiungimento della destinazione. È il più popolare per decisione e classificazione basato su algoritmi supervisionati. È costruito dal partizionamento ricorsivo in cui ciascun nodo funge da test case per alcuni attributi e ogni fronte, derivante dal nodo, è una possibile risposta nel test case. Entrambi i nodi radice e foglia sono due entità dell'algoritmo.

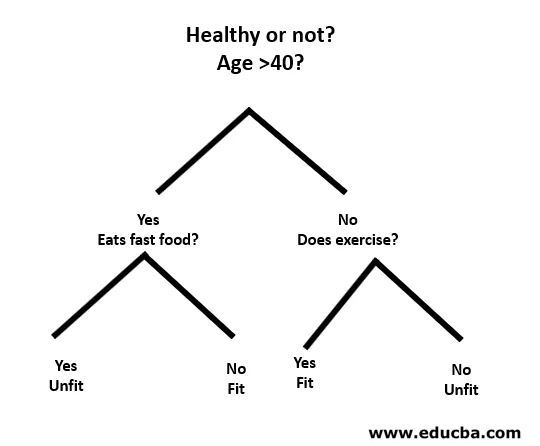

Comprendiamo con l'aiuto di un piccolo esempio come segue:

Qui, il nodo principale è se hai meno di 40 anni. Se è così, allora mangi fast food? Se sì, allora non sei idoneo, oppure sei in forma. E se hai più di 40 anni, ti alleni? In tal caso, allora sei in forma, oppure non sei idoneo. Questa era sostanzialmente una classificazione binaria.

Esistono due tipi di alberi decisionali:

- Alberi di classificazione: l'esempio sopra è un albero di classificazione basato su categorie.

- Alberi di regressione : in questo tipo di algoritmo, la decisione o il risultato sono continui. Ha un singolo output numerico con più input o predittori.

Nell'albero decisionale, la sfida tipica è identificare l'attributo in ciascun nodo. Il processo si chiama selezione degli attributi e ha alcune misure da utilizzare per identificare l'attributo.

un. Guadagno informativo (IG)

Il guadagno delle informazioni misura la quantità di informazioni che una singola funzionalità fornisce sulla classe. Funziona come la chiave principale per costruire un albero decisionale. Un attributo con il più alto guadagno di informazioni si divide per primo. Pertanto, l'albero decisionale massimizza sempre il guadagno delle informazioni. Quando usiamo un nodo per partizionare le istanze in sottoinsiemi più piccoli, allora l'entropia cambia.

Entropia: è la misura dell'incertezza o dell'impurità in una variabile casuale. L'entropia decide come un albero decisionale divide i dati in sottoinsiemi.

L'equazione per guadagno di informazioni ed entropia è la seguente:

Guadagno informativo = entropia (genitore) - (media ponderata * entropia (bambini))

Entropia: ∑p (X) log p (X)

P (X) qui è la frazione di esempi in una data classe.

b. Indice Gini

Gini Index è una metrica che decide con quale frequenza un elemento scelto casualmente verrà identificato in modo errato. Indica chiaramente che la prima preferenza è data all'attributo con un indice Gini basso.

Indice Gini: 1-∑ p (X) 2

Creazione divisa

- Per creare una divisione, prima, dobbiamo calcolare il punteggio Gini.

- I dati vengono suddivisi utilizzando un elenco di righe con un indice di un attributo e un valore di divisione di tale attributo. Dopo aver trovato il set di dati destro e sinistro, possiamo ottenere il valore di divisione per il punteggio Gini dalla prima parte. Ora, il valore di divisione sarà il decisore in cui risiederà l'attributo.

- La parte successiva sta valutando tutte le divisioni. Il miglior valore possibile viene calcolato valutando il costo della divisione. La divisione migliore viene utilizzata come nodo dell'albero decisionale.

Costruire un albero - Albero decisionale nell'apprendimento automatico

Esistono due passaggi per la creazione di un albero decisionale.

1. Creazione del nodo terminale

Durante la creazione del nodo terminale, la cosa più importante è notare se è necessario interrompere la crescita degli alberi o procedere oltre. I seguenti modi possono essere usati per questo:

- Profondità massima dell'albero: quando l'albero raggiunge il numero massimo di nodi, l'esecuzione si interrompe lì.

- Record minimi di nodo: può essere definito come un minimo di pattern richiesti da un nodo. Quindi possiamo smettere di aggiungere nodi terminali immediatamente otteniamo quei record minimi di nodo.

2. Suddivisione ricorsiva

Una volta creato il nodo, possiamo creare un nodo figlio ricorsivamente suddividendo il set di dati e chiamando la stessa funzione più volte.

Predizione

Dopo la creazione di un albero, la previsione viene eseguita utilizzando una funzione ricorsiva. Lo stesso processo di previsione viene seguito nuovamente con nodi figlio sinistro o destro e così via.

Vantaggi e svantaggi dell'albero decisionale

Di seguito sono riportati alcuni vantaggi e svantaggi:

vantaggi

L'albero decisionale presenta alcuni vantaggi nell'apprendimento automatico come segue:

- Completo: prende in considerazione ogni possibile risultato di una decisione e traccia di conseguenza ogni nodo fino alla conclusione.

- Specifico: gli alberi decisionali assegnano un valore specifico a ciascun problema, decisione ed esito (i). Riduce l'incertezza e l'ambiguità e aumenta anche la chiarezza.

- Semplicità: Decision Tree è uno degli algoritmi più semplici e affidabili in quanto non ha formule o strutture dati complesse. Per il calcolo sono necessarie solo statistiche e matematica semplici.

- Versatile: gli alberi decisionali possono essere costruiti manualmente utilizzando la matematica e possono anche essere utilizzati con altri programmi per computer.

svantaggi

L'albero decisionale presenta alcuni svantaggi nell'apprendimento automatico come segue:

- Gli alberi delle decisioni sono meno appropriati per la stima e le attività finanziarie in cui abbiamo bisogno di un valore (i) adeguato (i).

- È un algoritmo di classificazione soggetto a errori rispetto ad altri algoritmi computazionali.

- È computazionalmente costoso. Ad ogni nodo, la divisione candidata deve essere ordinata prima di accertare il meglio. Esistono altre alternative che molte entità aziendali seguono per attività finanziarie poiché l'albero decisionale è troppo costoso per la valutazione.

- Mentre si lavora con variabili continue, Decision Tree non è la soluzione migliore in quanto tende a perdere informazioni durante la classificazione delle variabili.

- Talvolta è instabile poiché piccole variazioni nel set di dati potrebbero portare alla formazione di un nuovo albero.

Conclusione - Albero decisionale nell'apprendimento automatico

Essendo uno degli algoritmi più importanti e supervisionati, Decision Tree gioca un ruolo vitale nell'analisi delle decisioni nella vita reale. Come modello predittivo, viene utilizzato in molte aree per il suo approccio diviso che aiuta a identificare soluzioni basate su condizioni diverse mediante classificazione o metodo di regressione.

Articoli consigliati

Questa è una guida all'albero decisionale nell'apprendimento automatico. Qui discutiamo l'introduzione, i tipi di albero decisionale nell'apprendimento automatico, la creazione divisa e la costruzione di un albero. Puoi anche consultare i nostri altri articoli suggeriti per saperne di più–

- Tipi di dati Python

- Set di dati del tableau

- Modellazione dei dati Cassandra

- Test della tabella decisionale

- Le 8 fasi principali del ciclo di vita dell'apprendimento automatico