Come installare Spark?

Spark è un framework open source per l'esecuzione di applicazioni di analisi. È un motore di elaborazione dati ospitato presso Apache Software Foundation indipendente dal fornitore per lavorare su set di dati di grandi dimensioni o big data. Si tratta di un sistema di elaborazione cluster per scopi generici che fornisce API di alto livello in Scala, Python, Java e R. È stato sviluppato per superare i limiti del paradigma MapReduce di Hadoop. I data scientist credono che Spark sia 100 volte più veloce di MapReduce in quanto può memorizzare nella cache i dati mentre MapReduce funziona di più leggendo e scrivendo sui dischi. Esegue l'elaborazione in memoria che la rende più potente e veloce.

Spark non ha un proprio file system. Elabora i dati da diverse fonti di dati come Hadoop Distributed File System (HDFS), il sistema S3 di Amazon, Apache Cassandra, MongoDB, Alluxio, Apache Hive. Può essere eseguito su Hadoop YARN (Yet Another Resource Negotiator), su Mesos, su EC2, su Kubernetes o utilizzando la modalità cluster autonoma. Utilizza RDD (Resilient Distributed Dataset) per delegare carichi di lavoro a singoli nodi che supportano in applicazioni iterative. Grazie a RDD, la programmazione è semplice rispetto a Hadoop.

Spark è costituito da vari componenti chiamati componenti Spark Ecosystem.

- Spark Core: è il fondamento dell'applicazione Spark da cui dipendono direttamente altri componenti. Fornisce una piattaforma per un'ampia varietà di applicazioni come la pianificazione, l'invio di attività distribuite, l'elaborazione della memoria e il riferimento ai dati.

- Spark Streaming: è il componente che funziona sui dati di streaming live per fornire analisi in tempo reale. I dati in tempo reale vengono inseriti in unità discrete chiamate batch che vengono eseguiti su Spark Core.

- Spark SQL: è il componente che funziona sopra Spark core per eseguire query SQL su dati strutturati o semi-strutturati. Data Frame è il modo di interagire con Spark SQL.

- GraphX: è il motore o il framework di calcolo dei grafici che consente l'elaborazione dei dati dei grafici. Fornisce vari algoritmi grafici da eseguire su Spark.

- MLlib: contiene algoritmi di apprendimento automatico che forniscono un framework di apprendimento automatico in un ambiente distribuito basato sulla memoria. Esegue algoritmi iterativi in modo efficiente grazie alla capacità di elaborazione dei dati in memoria.

- SparkR: Spark fornisce un pacchetto R per eseguire o analizzare set di dati utilizzando la shell R.

Esistono tre modi per installare o distribuire spark sui tuoi sistemi:

- Modalità autonoma in Apache Spark

- Hadoop YARN / Mesos

- SIMR (Spark in MapReduce)

Vediamo la distribuzione in modalità autonoma.

Modalità di distribuzione autonoma Spark:

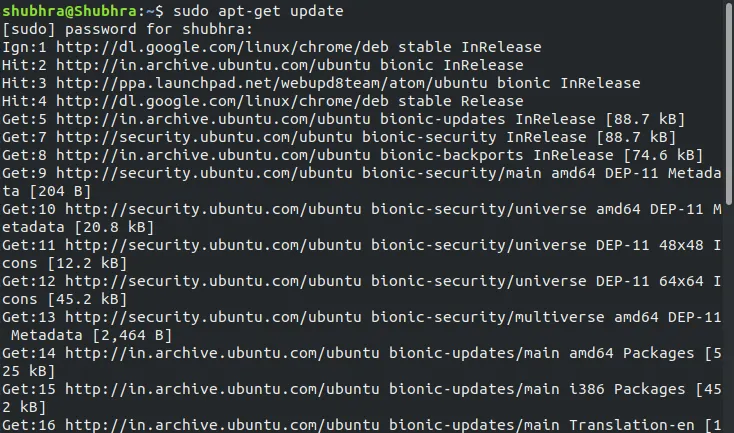

Passaggio 1: aggiornare l'indice del pacchetto

Ciò è necessario per aggiornare tutti i pacchetti presenti nella macchina.

Utilizzare il comando : $ sudo apt-get update

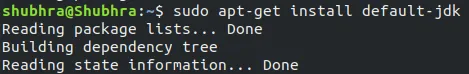

Passaggio 2: installare Java Development Kit (JDK)

Questo installerà JDK sul tuo computer e ti aiuterebbe ad eseguire applicazioni Java.

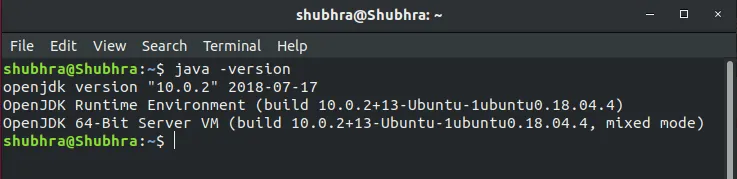

Passaggio 3: verificare che Java sia installato correttamente

Java è un prerequisito per l'utilizzo o l'esecuzione di Apache Spark Applications.

Usa il comando : $ java –version

Questa schermata mostra la versione java e assicura la presenza di java sulla macchina.

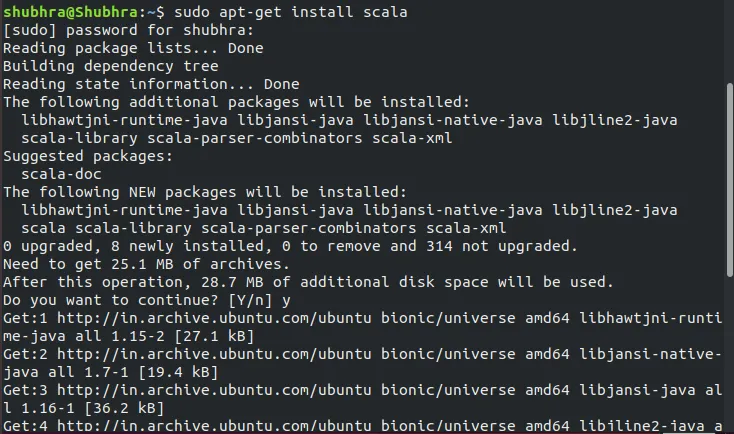

Passaggio 4: installa Scala sul tuo computer

Poiché Spark è scritto in scala, scale deve essere installato per eseguire spark sul tuo computer.

Usa il comando: $ sudo apt-get install scala

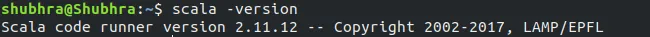

Passaggio 5: verificare che Scala sia installato correttamente

Ciò garantirà la corretta installazione della bilancia sul sistema.

Usa il comando : $ scala –version

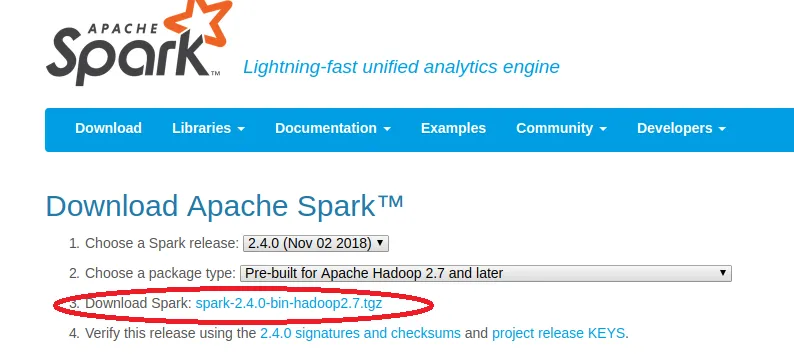

Passaggio 6: Scarica Apache Spark

Scarica Apache Spark secondo la tua versione di Hadoop da https://spark.apache.org/downloads.html

Quando passerai al link sopra, apparirà una finestra.

Passaggio 7: selezionare la versione appropriata in base alla versione di Hadoop e fare clic sul collegamento contrassegnato.

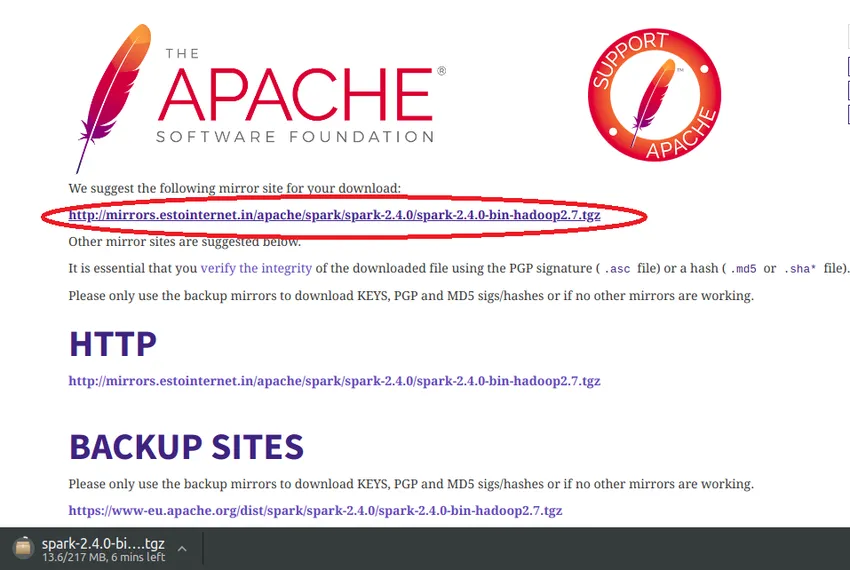

Apparirà un'altra finestra.

Passaggio 8: fare clic sul collegamento contrassegnato e Apache Spark verrà scaricato nel sistema.

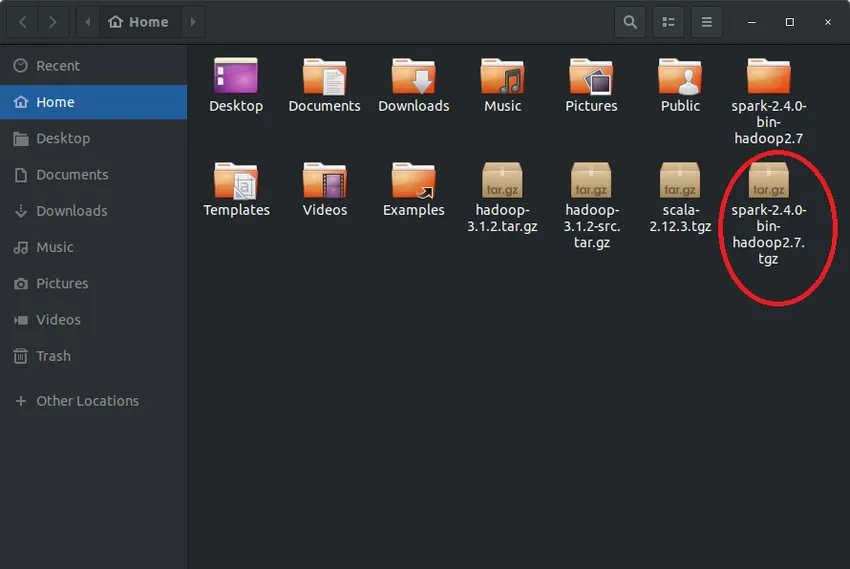

Verifica se il file .tar.gz è disponibile nella cartella dei download.

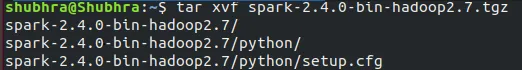

Passaggio 9: installare Apache Spark

Per l'installazione di Spark, è necessario estrarre il file tar.

Usa il comando: $ tar xvf spark- 2.4.0-bin-hadoop2.7.tgz

È necessario modificare la versione menzionata nel comando in base alla versione scaricata. In questo, abbiamo scaricato la versione spark-2.4.0-bin-hadoop2.7.

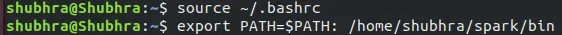

Passaggio 10: installazione della variabile di ambiente per Apache Spark

Usa il comando: $ source ~ / .bashrc

Aggiungi riga : export PATH = $ PATH: / usr / local / spark / bin

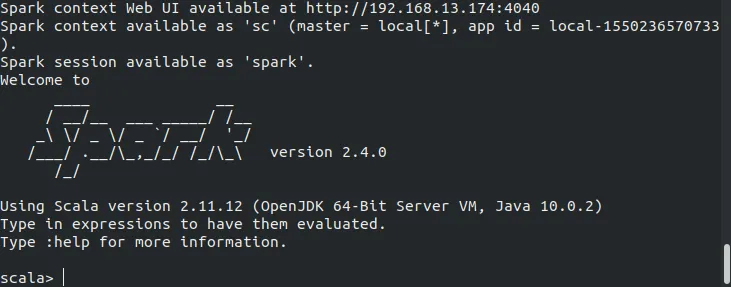

Passaggio 11: verificare l'installazione di Apache Spark

Usa il comando : $ spark-shell

Se l'installazione ha avuto esito positivo, verrà prodotto il seguente output.

Ciò significa che l'installazione di Apache Spark sul tuo computer è stata eseguita correttamente e Apache Spark verrà avviato in Scala.

Distribuzione di Spark su Hadoop YARN:

Esistono due modalità per distribuire Apache Spark su Hadoop YARN.

- Modalità cluster: in questa modalità YARN sul cluster gestisce il driver Spark che viene eseguito all'interno di un processo master dell'applicazione. Dopo aver avviato l'applicazione, il client può andare.

- Modalità client: in questa modalità, le risorse sono richieste a YARN dal master dell'applicazione e il driver Spark viene eseguito nel processo client.

Per distribuire un'applicazione Spark in modalità cluster, utilizzare il comando:

$spark-submit –master yarn –deploy –mode cluster mySparkApp.jar

Il comando precedente avvierà un programma client YARN che avvierà il master applicazione predefinito.

Per distribuire un'applicazione Spark in modalità client utilizzare il comando:

$ spark-submit –master yarn –deploy –mode client mySparkApp.jar

È possibile eseguire spark shell in modalità client utilizzando il comando:

$ spark-shell –master yarn –deploy-mode client

Suggerimenti e trucchi per utilizzare spark install:

- Assicurarsi che Java sia installato sul proprio computer prima di installare spark.

- Se usi il linguaggio scala, assicurati che la scala sia già installata prima di usare Apache Spark.

- Puoi usare Python anche al posto di Scala per la programmazione in Spark ma deve anche essere preinstallato come Scala.

- Puoi anche eseguire Apache Spark su Windows, ma è consigliabile creare una macchina virtuale e installare Ubuntu utilizzando Oracle Virtual Box o VMWare Player .

- Spark può funzionare senza Hadoop (ovvero modalità autonoma) ma se è necessaria un'installazione multi-nodo, sono necessari gestori di risorse come YARN o Mesos.

- Durante l'utilizzo di YARN non è necessario installare Spark su tutti e tre i nodi. Devi installare Apache Spark su un solo nodo.

- Durante l'utilizzo di YARN se ci si trova nella stessa rete locale con il cluster, è possibile utilizzare la modalità client, mentre se si è lontani, è possibile utilizzare la modalità cluster.

Articoli consigliati - Spark Install

Questa è stata una guida su come installare Spark. Qui abbiamo visto come distribuire Apache Spark in modalità autonoma e in cima al gestore risorse YARN e anche alcuni suggerimenti e trucchi sono menzionati anche per una facile installazione di Spark. Puoi anche leggere il seguente articolo per saperne di più -

- Come utilizzare i comandi Spark

- Una carriera in Spark - Devi provare

- Differenze tra Splunk e Spark

- Spark Intervista Domande e risposte

- Vantaggi dello Spark Streaming

- Tipi di join in Spark SQL (esempi)