Introduzione alla regressione lineare semplice

Dal dizionario : ritorno a uno stato precedente o meno sviluppato.

In Statistica: una misura della relazione tra il valore medio di una variabile e i valori corrispondenti delle altre variabili.

La regressione, in cui la relazione tra la variabile di input (variabile indipendente) e la variabile target (variabile dipendente) è considerata lineare si chiama regressione lineare. La regressione lineare semplice è un tipo di regressione lineare in cui abbiamo solo una variabile indipendente per prevedere la variabile dipendente. La regressione lineare semplice è uno degli algoritmi di apprendimento automatico. La regressione lineare semplice appartiene alla famiglia dell'apprendimento supervisionato. La regressione viene utilizzata per prevedere i valori continui.

Modello di regressione lineare semplice

Rendiamolo semplice. Come tutto è cominciato?

Tutto ebbe inizio nel 1800 con Francis Galton. Ha studiato il rapporto in altezza tra i padri e i loro figli. Osservò uno schema: l'altezza del figlio sarebbe alta quanto quella del padre o l'altezza del figlio tenderà ad essere più vicina all'altezza media complessiva di tutte le persone. Questo fenomeno non è altro che regressione.

Ad esempio, Shaq O'Neal è un giocatore NBA molto famoso ed è alto 2, 16 metri. I suoi figli Shaqir e Shareef O'neal sono alti rispettivamente 1, 96 metri e 2, 06 metri. L'altezza media della popolazione è di 1, 76 metri. L'altezza del figlio regredisce (si sposta verso) l'altezza media.

Come facciamo la regressione?

Calcolo di una regressione con solo due punti dati:

Tutto ciò che vogliamo fare per trovare la migliore regressione è tracciare una linea il più vicino possibile a ogni punto. Nel caso di due punti dati è facile tracciare una linea, basta unirli.

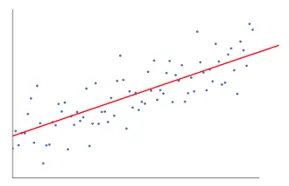

Ora, se stiamo avendo un certo numero di punti dati ora come disegnare la linea il più vicino possibile a ogni punto dati.

In questo caso, il nostro obiettivo è ridurre al minimo la distanza verticale tra la linea e tutti i punti dati. In questo modo, prevediamo la migliore linea per il nostro modello di regressione lineare.

Che cosa fa la regressione lineare semplice?

Di seguito è riportata la spiegazione dettagliata della regressione lineare semplice:

- Disegna un sacco di possibili linee di linee e quindi esegue una qualsiasi di queste analisi.

- Somma degli errori al quadrato.

- Somma degli errori assoluti.

- metodo del minimo quadrato … ecc

- Per la nostra analisi, useremo il metodo meno quadrato.

- Faremo la differenza di tutti i punti e calcoleremo il quadrato della somma di tutti i punti. Qualunque riga fornisca la somma minima sarà la nostra migliore linea.

Per esempio: facendo questo potremmo prendere più uomini e l'altezza del loro figlio e fare cose come dire a un uomo quanto potrebbe essere alto suo figlio. prima ancora che nascesse.

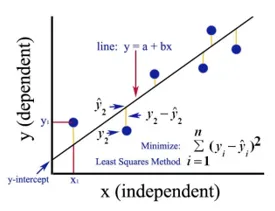

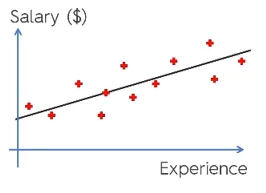

Immagine google

La figura sopra mostra una semplice regressione lineare. La linea rappresenta la linea di regressione. Dato da: y = a + b * x

Dove y è la variabile dipendente (DV): ad esempio, come cambia lo stipendio di una persona a seconda del numero di anni di esperienza che il dipendente ha. Quindi qui lo stipendio di un dipendente o persona sarà la tua variabile dipendente.

La variabile dipendente è la nostra variabile target, quella che vogliamo prevedere usando la regressione lineare.

x è la nostra variabile indipendente (IV): la variabile dipendente è la causa della variabile indipendente dal cambiamento. Nell'esempio sopra, il numero di anni di esperienza è la nostra variabile dipendente, poiché il numero di anni di esperienza sta causando il cambiamento nella retribuzione del dipendente.

- b è la variabile del coefficiente per la nostra variabile indipendente x. Questo coefficiente svolge un ruolo cruciale. Indica come un cambio di unità in x (IV) influenzerà y (DV). Viene indicato anche come coefficiente di proporzionato. In termini di matematica, dipende da te la pendenza della linea o puoi dire ripida della linea.

- Nel nostro esempio, se la pendenza (b) è inferiore, il che significa che il numero di anni produrrà un incremento del salario inferiore se invece la pendenza (b) è maggiore produrrà un aumento elevato del salario con un aumento del numero di Anni di esperienza.

- a è un valore costante. Viene anche chiamata intercettazione, ovvero dove la linea interseca l'asse y o l'asse DV. In un altro modo possiamo dire quando un dipendente ha zero anni di esperienza (x), quindi lo stipendio (y) per quel dipendente sarà costante (a).

Come funziona Least Square?

Di seguito sono riportati i punti per il lavoro meno quadrato:

- Traccia una linea arbitraria in base all'andamento dei dati.

- Prende punti dati e disegna linee verticali. Considera la distanza verticale come un parametro.

- Queste linee verticali tagliano la linea di regressione e forniscono il punto corrispondente per i punti dati.

- Quindi troverà la differenza verticale tra ciascun punto dati e il corrispondente punto dati sulla linea di regressione.

- Calcolerà l'errore che è il quadrato della differenza.

- Quindi calcola la somma degli errori.

- Quindi disegna una linea e ripeterà nuovamente la procedura sopra descritta.

- Disegna un numero di linee in questo modo e la linea che fornisce la minima somma di errore viene scelta come linea migliore.

- Questa linea migliore è la nostra semplice linea di regressione lineare.

Applicazione della regressione lineare semplice

L'analisi di regressione viene eseguita per prevedere la variabile continua. L'analisi di regressione ha un'ampia varietà di applicazioni. Alcuni esempi sono i seguenti:

- Analisi predittiva

- Efficacia del marketing,

- prezzi di qualsiasi annuncio

- previsione di promozione per un prodotto.

Qui discuteremo di un'applicazione della regressione lineare per l'analisi predittiva. Faremo la modellazione usando Python.

I passi che seguiremo per costruire il nostro modello sono i seguenti:

- Importeremo le librerie e i set di dati.

- Pre-elaboreremo i dati.

- Divideremo i dati nel set di test e nel set di training.

- Creeremo un modello che proverà a prevedere la variabile target in base al nostro set di allenamento

- Prediremo la variabile target per il set di test.

- Analizzeremo i risultati previsti dal modello

Per la nostra analisi, utilizzeremo un set di dati salariali con i dati di 30 dipendenti.

# Importazione delle librerie

import numpy as np

import matplotlib.pyplot as plt

import pandas as pd

# Importazione del set di dati (un esempio di dati è mostrato nella tabella)

dataset = pd.read_csv('Salary_Data.csv')

| Anni di esperienza | Stipendio |

| 1.5 | 37731 |

| 1.1 | 39343 |

| 2.2 | 39891 |

| 2 | 43525 |

| 1.3 | 46205 |

| 3.2 | 54445 |

| 4 | 55749 |

# Pre-elaborazione del set di dati, qui divideremo il set di dati nella variabile dipendente e variabile indipendente. x come indipendente e y come variabile dipendente o target

X = dataset.iloc(:, :-1).values

y = dataset.iloc(:, 1).values

# Suddivisione del set di dati nel set di allenamento e nel set di test:

from sklearn.model_selection import train_test_split

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size = 1/3, random_state = 0)

Qui la dimensione del test 1/3 mostra che dai dati totali 2/3 è per l'addestramento del modello e il resto 1/3 è usato per testare il modello.

# Adattiamo il nostro modello di regressione lineare semplice al set di allenamento

from sklearn.linear_model import LinearRegression

regressor = LinearRegression()

regressor.fit(X_train, y_train)

Il modello di regressione lineare è ora addestrato. Questo modello verrà utilizzato per prevedere la variabile dipendente.

# Previsione dei risultati del set di test

y_pred = regressor.predict(X_test)

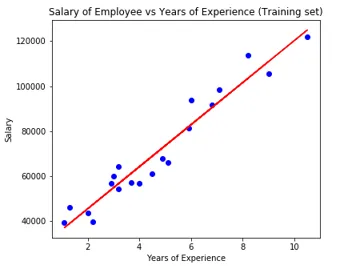

# Visualizzazione dei risultati del set di test

plt.scatter(X_test, y_test, color = 'blue')

plt.plot(X_train, regressor.predict(X_train), color = 'red')

plt.title('Salary of Employee vs Experience (Test set)')

plt.xlabel('Years of Experience')

plt.ylabel('Salary')

plt.show()

# Parametro del modello

print(regressor.intercept_)

print(regressor.coef_)

26816.19224403119

(9345.94244312)

Quindi il valore dell'interceptor (a) è 26816. Il che suggerisce che qualsiasi esperienza più fresca (zero esperienza) sarebbe di ottenere circa 26816 quantità come stipendio.

Il coefficiente per il nostro modello è risultato essere 9345.94. Suggerisce che mantenendo costanti tutti gli altri parametri, la variazione di un'unità della variabile indipendente (anni di scadenza) produrrà una variazione di 9345 unità di stipendio.

Metriche di valutazione della regressione

Esistono sostanzialmente 3 metodi di metrica di valutazione importanti disponibili per l'analisi di regressione:

- Mean Absolute Error (MAE): mostra la media degli errori assoluti, che è la differenza tra previsto e reale.

- Mean Squared Error (MSE): mostra il valore medio degli errori al quadrato.

- Errore radice quadrata media (RMSE): mostra la radice quadrata della media degli errori quadrati.

Possiamo confrontare questi metodi sopra:

- MAE: mostra l'errore medio e il più semplice di tutti e tre i metodi.

- MSE: questo è più popolare di MAE perché migliora gli errori più grandi, che di conseguenza mostrano più approfondimenti.

- RMSE: Questo è meglio di MSE perché possiamo interpretare l'errore in termini di y.

Questi 3 non sono altro che le funzioni di perdita.

# Valutazione del modello

from sklearn import metrics

print('MAE:', metrics.mean_absolute_error(y_test, y_pred))

print('MSE:', metrics.mean_squared_error(y_test, y_pred))

print('RMSE:', np.sqrt(metrics.mean_squared_error(y_test, y_pred)))

MAE: 3426.4269374307123

MSE: 21026037.329511296

RMSE: 4585.4157204675885

Conclusione

L'analisi della regressione lineare è un potente strumento per gli algoritmi di apprendimento automatico, che viene utilizzato per prevedere variabili continue come salario, vendite, prestazioni, ecc. La regressione lineare considera la relazione lineare tra variabili indipendenti e dipendenti. La regressione lineare semplice ha solo una variabile indipendente in base alla quale il modello prevede la variabile target. Abbiamo discusso del modello e dell'applicazione della regressione lineare con un esempio di analisi predittiva per prevedere lo stipendio dei dipendenti.

Articoli consigliati

Questa è una guida alla regressione lineare semplice. Qui discutiamo il modello e l'applicazione della regressione lineare, usando un esempio di analisi predittiva per prevedere gli stipendi dei dipendenti. Puoi anche consultare i nostri altri articoli correlati per saperne di più-

- Analisi di regressione lineare

- Regressione lineare in R

- Modellazione di regressione lineare

- Strumenti di test di regressione

- Matplotlib In Python | Top 14 trame in Matplotlib

- Dizionario in Python | Metodi ed esempi

- Esempi di radice quadrata in PHP

- Regressione lineare vs regressione logistica | Differenze principali