Differenza tra Apache Hive e Apache Spark SQL

Con l'enorme aumento delle tecnologie per i big data oggi, sta diventando molto importante utilizzare lo strumento giusto per ogni processo. Il processo può essere qualsiasi cosa come l'ingestione dei dati, l'elaborazione dei dati, il recupero dei dati, l'archiviazione dei dati, ecc. In questo post, andremo a leggere due di questi strumenti di recupero dei dati, Apache Hive e Apache Spark SQL. Hive, da un lato, è noto per la sua efficiente elaborazione delle query utilizzando HQL (Hive Query Language) simile a SQL e viene utilizzato per i dati archiviati nel file system distribuito Hadoop mentre Spark SQL utilizza un linguaggio di query strutturato e si assicura che tutto le operazioni di lettura e scrittura online sono curate. Hive è noto per essere il componente dell'ecosistema Big Data in cui sono necessari mappatori e riduttori legacy per elaborare i dati da HDFS mentre Spark SQL è noto per essere il componente dell'API Spark di Apache che ha reso l'elaborazione sull'ecosistema Big Data molto più semplice e reale -tempo. Un grande equivoco della maggior parte dei professionisti di oggi è che l'alveare può essere utilizzato solo con la tecnologia e gli strumenti Big Data legacy come PIG, HDFS, Sqoop, Oozie. Questa affermazione non è completamente vera in quanto Hive è compatibile non solo con gli strumenti legacy ma anche con altri componenti basati su Spark, come Spark Streaming. L'idea alla base del loro utilizzo è quella di ridurre lo sforzo e portare un output migliore per l'azienda. Analizziamo in dettaglio sia Apache Hive che Apache Spark SQL.

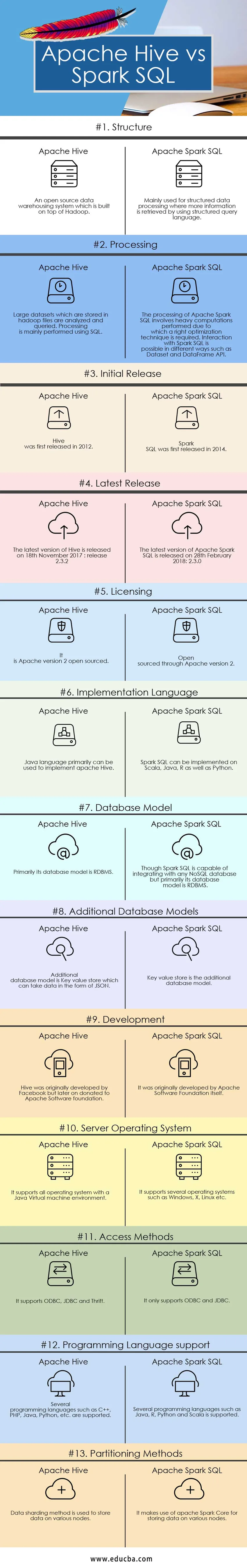

Confronto diretto tra Apache Hive e Apache Spark SQL (infografica)

Di seguito è riportato il Top 13 di confronto tra Apache Hive e Apache Spark SQL

Differenze chiave tra Apache Hive e Apache Spark SQL

Differenze chiave tra Apache Hive e Apache Spark SQL

Le differenze tra Apache Hive e Apache Spark SQL sono discusse nei punti indicati di seguito:

- Hive è noto per utilizzare HQL (Hive Query Language) mentre Spark SQL è noto per utilizzare il linguaggio Structured Query per l'elaborazione e l'interrogazione dei dati

- Hive offre flessibilità dello schema, porzionando e inclinando le tabelle mentre mentre Spark SQL esegue query SQL è possibile solo leggere i dati dall'installazione di Hive esistente.

- Hive fornisce diritti di accesso per utenti, ruoli e gruppi, mentre Spark SQL non fornisce alcuna possibilità di fornire diritti di accesso a un utente

- Hive offre la possibilità di un fattore di replica selettiva per la memorizzazione ridondante dei dati, mentre spark SQL, d'altra parte, non fornisce alcun fattore di replica per la memorizzazione dei dati

- Dato che JDBC, ODBC e driver di risparmio sono disponibili in Hive, possiamo usarli per generare risultati mentre nel caso di Apache Spark SQL possiamo recuperare i risultati sotto forma di set di dati e API DataFrame se Spark SQL viene eseguito con un altro linguaggio di programmazione

- Esistono diverse limitazioni:

- Gli aggiornamenti a livello di riga e le query OLTP in tempo reale non sono possibili utilizzando Apache Hive, mentre gli aggiornamenti a livello di riga e l'elaborazione delle transazioni online in tempo reale sono possibili tramite Spark SQL.

- Fornisce un'elevata latenza accettabile per l'esplorazione interattiva dei dati, mentre in Spark SQL la latenza fornita è al minimo per migliorare le prestazioni.

- Hive, come le istruzioni e le query SQL, supporta il tipo UNION mentre Spark SQL non è in grado di supportare il tipo UNION.

Tabella di confronto tra Apache Hive e Apache Spark SQL

| Base di confronto | Apache Hive | Apache Spark SQL |

| Struttura | Un sistema di data warehousing open source basato su Hadoop | Utilizzato principalmente per l'elaborazione di dati strutturati in cui vengono recuperate più informazioni utilizzando il linguaggio di query strutturato. |

| in lavorazione | I set di dati di grandi dimensioni memorizzati nei file hadoop vengono analizzati e sottoposti a query. L'elaborazione viene eseguita principalmente tramite SQL. | L'elaborazione di Apache Spark SQL comporta calcoli pesanti eseguiti a causa dei quali è necessaria una giusta tecnica di ottimizzazione. L'interazione con Spark SQL è possibile in diversi modi come Dataset e DataFrame API. |

| Versione iniziale | Hive è stato rilasciato per la prima volta nel 2012 | Spark SQL è stato rilasciato per la prima volta nel 2014 |

| Ultima uscita | L'ultima versione di Hive è stata rilasciata il 18 novembre 2017: versione 2.3.2 | L'ultima versione di Apache Spark SQL è stata rilasciata il 28 febbraio 2018: 2.3.0 |

| Licensing | È Apache versione 2 open source | Open source tramite Apache versione 2 |

| Linguaggio di implementazione | Il linguaggio Java può essere utilizzato principalmente per implementare apache Hive | Spark SQL può essere implementato su Scala, Java, R e Python |

| Modello di database | Principalmente il suo modello di database è RDBMS | Sebbene Spark SQL sia in grado di integrarsi con qualsiasi database NoSQL, ma principalmente il suo modello di database è RDBMS |

| Modelli di database aggiuntivi | Il modello di database aggiuntivo è un archivio di valori-chiave che può assumere dati sotto forma di JSON | L'archivio valori-chiave è il modello di database aggiuntivo |

| Sviluppo | Hive è stato originariamente sviluppato da Facebook ma in seguito donato alla fondazione Apache Software | È stato originariamente sviluppato dalla stessa Apache Software Foundation |

| Sistema operativo del server | Supporta tutti i sistemi operativi con un ambiente Java Virtual machine | Supporta diversi sistemi operativi come Windows, X, Linux ecc. |

| Metodi di accesso | Supporta ODBC, JDBC e parsimonia | Supporta solo ODBC e JDBC |

| Supporto per il linguaggio di programmazione | Sono supportati numerosi linguaggi di programmazione come C ++, PHP, Java, Python, ecc | Sono supportati numerosi linguaggi di programmazione come Java, R, Python e Scala |

| Metodi di partizionamento | Il metodo di condivisione dei dati viene utilizzato per archiviare i dati su vari nodi | Utilizza Apache Spark Core per l'archiviazione dei dati su vari nodi |

Conclusione - Apache Hive vs Apache Spark SQL

Non possiamo dire che Apache Spark SQL sia il sostituto di Hive o viceversa. È solo che Spark SQL può essere visto come un'API basata su Spark per sviluppatori che ha lo scopo di facilitare la programmazione. Hive ha la sua speciale capacità di passare frequentemente da un motore all'altro e quindi è uno strumento efficiente per eseguire query su grandi set di dati. L'uso e l'implementazione rispetto a cosa scegliere dipende dai tuoi obiettivi e requisiti. Sia Apache Hive che Apache Spark SQL sono giocatori nel loro stesso campo. Spero che dopo aver esaminato il post, avrai un'idea abbastanza chiara delle esigenze della tua organizzazione. Segui il nostro blog per altri post come questi e ci assicuriamo di fornire informazioni che promuovano la tua attività.

Articolo raccomandato

Questa è stata una guida per Apache Hive vs Apache Spark SQL, il loro significato, confronto testa a testa, differenze chiave, tabella di confronto e conclusioni. Puoi anche consultare i seguenti articoli per saperne di più -

- Differenze Java vs Node JS

- Apache Pig vs Apache Hive - Le 12 principali differenze utili

- Hadoop vs Hive - Scopri le migliori differenze

- 7 importanti cose utili su Apache Spark (Guida)

- Apache Hadoop vs Apache Spark | I 10 migliori confronti che devi sapere!

- Utilizzo della funzione ORDER BY in Hive