Cos'è l'algoritmo Boosting?

Il potenziamento è il metodo negli algoritmi che converte il discente debole in discente forte. È una tecnica che aggiunge nuovi modelli per correggere gli errori dei modelli esistenti.

Esempio:

Comprendiamo questo concetto con l'aiuto del seguente esempio. Facciamo un esempio dell'email. Come riconoscerai la tua e-mail che si tratti di spam o no? È possibile riconoscerlo dalle seguenti condizioni:

- Se un'e-mail contiene molte fonti del genere, significa che è spam.

- Se un'e-mail contiene solo un'immagine di file, si tratta di spam.

- Se un'e-mail contiene il messaggio "Possiedi una lotteria di $ xxxxx" significa che si tratta di spam.

- Se un'e-mail contiene una fonte nota, non si tratta di spam.

- Se contiene il dominio ufficiale come educba.com, ecc. Significa che non è spam.

Le regole di cui sopra non sono molto potenti per riconoscere lo spam o no, quindi queste regole sono chiamate come studenti deboli.

Per convertire uno studente debole in uno studente forte, combinare la previsione dello studente debole usando i seguenti metodi.

- Utilizzando la media o la media ponderata.

- Considera che la previsione ha un voto più alto.

Considera le 5 regole sopra menzionate, ci sono 3 voti per lo spam e 2 voti per non lo spam. Poiché esiste uno spam con votazione elevata, lo consideriamo come spam.

Come funzionano gli algoritmi di potenziamento?

Promuovere gli algoritmi combina ogni studente debole per creare una forte regola di predizione. Per identificare la regola debole, esiste un algoritmo di apprendimento di base (Machine Learning). Ogni volta che viene applicato l'algoritmo di base, crea nuove regole di previsione utilizzando il processo di iterazione. Dopo alcune iterazioni, combina tutte le regole deboli per creare un'unica regola di previsione.

Per scegliere la giusta distribuzione segui i passaggi sotto indicati:

Passaggio 1: l' algoritmo di apprendimento di base combina ciascuna distribuzione e applica lo stesso peso a ciascuna distribuzione.

Passaggio 2: se si verifica una previsione durante l'algoritmo di apprendimento della prima base, prestiamo molta attenzione a tale errore di previsione.

Passaggio 3: ripetere il passaggio 2 fino a quando non è stato raggiunto il limite dell'algoritmo di apprendimento di base o un'elevata precisione.

Step 4: Infine, combina tutti gli studenti deboli per creare una formula di previsione forte.

Tipi di algoritmo di potenziamento

Gli algoritmi di boosting utilizzano diversi motori come il timbro di decisione, l'algoritmo di classificazione che massimizza i margini, ecc. Esistono tre tipi di algoritmi di boosting che sono i seguenti:

- Algoritmo AdaBoost (Adaptive Boosting)

- Algoritmo di incremento gradiente

- Algoritmo XG Boost

Algoritmo AdaBoost (Adaptive Boosting)

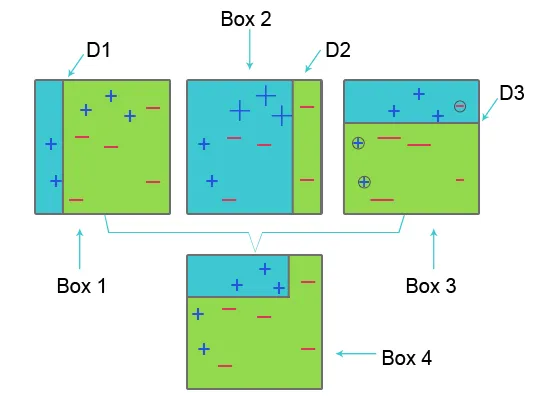

Per comprendere AdaBoost, fai riferimento all'immagine seguente:

Riquadro 1: Nel riquadro 1 per ciascun set di dati abbiamo assegnato pesi uguali e per classificare il segno più (+) e meno (-) applichiamo il ceppo di decisione D1 che crea una linea verticale sul lato sinistro del riquadro 1. Questa linea non è corretta previsto tre segni più (+) come meno (-) quindi applichiamo pesi più elevati a questi segni più e applichiamo un altro moncone decisionale.

Riquadro 2: Nel riquadro 2 la dimensione di tre segni più previsti in modo errato (+) aumenta rispetto a un altro. La seconda decisione moncone D2 sul lato destro del blocco prevede che questo segno più (+) non correttamente previsto sia corretto. Ma poiché si è verificato un errore di classificazione errata a causa della disparità di peso con un segno meno (-), assegniamo un peso maggiore a un segno meno (-) e applichiamo un altro moncone di decisione.

Casella 3: nella casella tre a causa dell'errore di classificazione errata, tre segni meno (-) hanno un peso elevato. qui viene applicato il ceppo di decisione D3 per prevedere questa classificazione errata e correggerla. Questa volta viene classificata la linea orizzontale del segno più (+) e meno (-).

Riquadro 4: Nel riquadro 4 il moncone decisionale D1, D2 e D3 sono combinati per creare una nuova previsione forte.

I lavori di potenziamento adattivo sono simili come menzionato sopra. Combina il gruppo di base del discente debole sull'età del peso per creare uno studente forte. Nella prima iterazione, attribuisce lo stesso peso a ciascun set di dati e inizia a prevedere tale set di dati. Se si verifica una previsione errata, si attribuisce un peso elevato a tale osservazione. L'amplificazione adattiva ripetere questa procedura nella successiva fase di iterazione e continuare fino a quando non è stata raggiunta la precisione. Quindi combina questo per creare una forte previsione.

Algoritmo di potenziamento del gradiente

L'algoritmo di aumento gradiente è una tecnica di apprendimento automatico per definire la funzione di perdita e ridurla. È usato per risolvere problemi di classificazione usando modelli di predizione. Implica i seguenti passaggi:

1. Funzione di perdita

L'uso della funzione di perdita dipende dal tipo di problema. Il vantaggio del potenziamento del gradiente è che non è necessario un nuovo algoritmo di potenziamento per ciascuna funzione di perdita.

2. Principiante debole

Nell'aumento del gradiente, gli alberi decisionali vengono utilizzati come discenti deboli. Un albero di regressione viene utilizzato per fornire valori reali che possono essere combinati insieme per creare previsioni corrette. Come nell'algoritmo AdaBoost, vengono utilizzati piccoli alberi con singola divisione, ad es. Ceppo decisionale. Alberi più grandi vengono utilizzati per grandi livelli i, e livelli 4-8.

3. Modello additivo

In questo modello, gli alberi vengono aggiunti uno alla volta. gli alberi esistenti rimangono gli stessi. Durante l'aggiunta di alberi, la pendenza viene utilizzata per ridurre al minimo la funzione di perdita.

XG Boost

XG Boost è l'abbreviazione di Extreme Gradient Boosting. XG Boost è un'implementazione aggiornata dell'algoritmo di incremento gradiente che è stato sviluppato per un'elevata velocità computazionale, scalabilità e prestazioni migliori.

XG Boost ha varie funzionalità che sono le seguenti:

- Elaborazione parallela: XG Boost fornisce l'elaborazione parallela per la costruzione di alberi che utilizza core della CPU durante l'allenamento.

- Convalida incrociata: XG Boost consente agli utenti di eseguire la convalida incrociata del processo di potenziamento ad ogni iterazione, facilitando così l'esatto numero ottimale di iterazioni di potenziamento in una corsa.

- Ottimizzazione della cache: fornisce l'ottimizzazione della cache degli algoritmi per una maggiore velocità di esecuzione.

- Calcolo distribuito : per l'addestramento di modelli di grandi dimensioni, XG Boost consente il calcolo distribuito.

Articoli consigliati

In questo articolo, abbiamo visto cos'è l'algoritmo di boosting, vari tipi di algoritmo di boosting nell'apprendimento automatico e nel loro funzionamento. Puoi anche consultare i nostri altri articoli suggeriti per saperne di più -

- Che cos'è l'apprendimento automatico? | Una definizione

- Linguaggi di programmazione per l'apprendimento degli algoritmi

- Cos'è la tecnologia Blockchain?

- Che cos'è un algoritmo?